呼叫中心中可定制报表系统的设计与实现(一)

上海易谷网络科技有限公司 赵延超 2010/01/11

本章阐述了本文写作的课题背景,介绍了呼叫中心中的报表系统以及其在国内外研究的现状,最后给出了本文的研究目的、研究意义和章节安排。

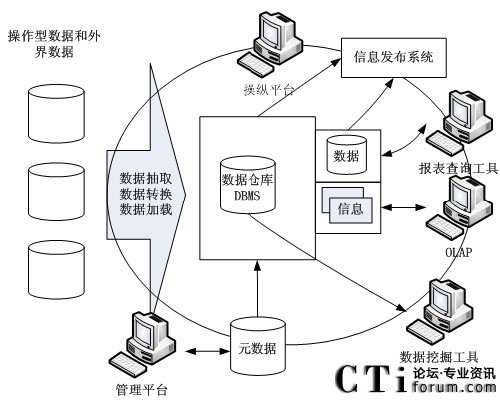

图1.1 呼叫中心基本架构图

呼叫中心通过电话自助语音方式来代替传统的柜台业务,能够每天24小时不间断地随时提供服务,并且有比柜台服务更好的友好服务界面。从而,用户不必跑到营业处,只要接入呼叫中心系统就能迅速获得信息和进行一些信息的存储、转发、查询、交换等操作,还可以通过呼叫中心完成部分交易[2]

[3]。另外,大多数呼叫中心还提供传真服务,它可以将交易记录等信息传真给客户。

1.1.2 报表系统

呼叫中心大规模使用以后,为了更好地衡量呼叫中心是否能够发挥最佳的绩效,以随时调整呼叫中心的运作策略,系统需要有统一的报表管理来对业务水平进行评价。

报表系统把呼叫中心中的数据进行组装,分析和包装管理,再以图表,文字和表格形式通过网络定期传播并更新,达其所用。它以一个规范的系统架构形式定期提供信息给决策者来支持他们的工作,来提高业务人员的服务态度和工作效率[4]。

与呼叫中心结合后,报表按照对呼叫中心中不同对象的数据统计,大致有以下几类。

1. 坐席报表

2. 坐席组报表

3. 队列报表

4. 队列组报表

5. 路由点报表

6. 技能组报表

7. 分机报表

8. IVR(Interactive Voice Response)报表

对这些报表的数据统计可以衡量呼叫中心中坐席服务态度、坐席服务是否专业、坐席业务熟悉程度、呼叫中心资源分配情况、业务流程的合理性、各部件工作效率等。下面以坐席为例,简要描述一下对呼叫中心中报表数据统计的详细内容以及作用。

1. 统计坐席接起电话以前电话铃响的时间,衡量坐席服务态度。

2. 统计坐席通话前客户在话路分配队列中等待时间,衡量呼叫中心资源分配是否合理。

3. 统计客户电话被挂起的次数和总的时间,衡量坐席服务是否专业。

4. 统计客户和坐席通话时间,衡量坐席业务熟悉程度、业务流程的合理性。

5. 统计坐席处于待机状态时间,衡量坐席数量是否过多。

6. 统计其它坐席参与三方通话的次数:衡量坐席业务熟悉程度以及业务流程的合理性。

7. 统计坐席处理一个来电/外拔的时间,衡量坐席工作效率。

8. 统计坐席输入资料的时间,衡量坐席对业务熟悉程度。

1.2 国内外研究现状

由于报表系统在呼叫中心系统中的基础性和必要性地位,报表统计功能的应用非常广泛。同时报表系统软件也引起了国内外不少人的关注和重视。近年来,随着软件开发技术的日新月异,报表技术不断成熟和完善,报表工具种类繁多并且功能各具特色,目前已经出现了一些颇具特色的报表工具软件。下面从国外和国内两个方面扼要介绍一下报表工具的研究现状和进展。

1.2.1 国外报表工具现状

国外主流的报表工具包括水晶报表(Crystal Report)、Style Report、FastReport、QuickReport、Excel等,它们比较侧重于大型数据的处理,样式非常规整,不过在呈现方面还不能直接满足国内报表大量的个性化定制需求[5]

[6]。下面以Excel和QuickReport为例介绍一下国外的报表工具特点。

1.Excel

Excel是历史悠久的电子表程序之一,功能强大,许多后来出现的Windows报表工具均受其影响,甚至在功能和界面上加以模仿[7] [8]。

Excel具有如下特点:

图2.1 数据仓库系统体系结构图

根据其本质而言,数据仓库具备以下四个关键特征[22]:

1.面向主题(Subject Oriented)的数据集合

数据仓库通常围绕一些主题,如“产品”、“销售商”、“消费者”等来进行组织。数据仓库关注的是决策者的数据建模与分析,而不针对日常操作和事务的处理。因此,数据仓库提供了特定主题的简明视图,排除了对于决策无用的数据。它面向主题是与传统数据库面向应用相对应的,是一个在较高层次上将数据归类的标准,每一个主题对应一个宏观的分析领域。

2.集成(Integrated)的数据集合

数据仓库通常是结合多个异种数据源构成的,异种数据源可能包括关系数据库、面向对象数据库、文本数据库、Web数据库、一般文件等。集成的数据集合是指在这些数据源中的数据进入数据仓库之前,必须经过数据加工和集成,这是建立数据仓库的关键步骤,首先要清洗原始数据中的矛盾之处,还要将原始数据结构做一个从面向应用和面向主题的转变。

3.时变(Time Variant)的数据集合

数据存储从历史的角度提供信息,所以数据仓库中包含时间元素,它所提供的信息总是与时间相关联的。数掘仓库中存储的是一个时间段的数据,而不仅仅是某一个时刻的数据。它要求数据仓库中的数据保存时限能满足进行决策分析的需要,而且数据仓库中的数据都要标明该数据的历史时期。

4.非易失(Nonvolatile)的数据集合

数据仓库总是与操作环境下的实时应用数据分离存放,因此不需要事务处理、恢复和并发控制机制。数据仓库里的数据通常只需要两种操作:初始化载入和数据访问。它反映的是历史数据的内容,而不是日常事务处理产生的数据,数据经加工和集成进入数据仓库后是极少或根本不修改的。因此其数据相对稳定,极少或根本不更新。

综上所述,数据仓库是一种语义上规范的数据存储,它在决策支持数据模型中充当物理实现的角色,并存放企业战略决策所需的信息。数据仓库也常常被视为一种体系结构,通过将异种数据源中的数据集成在一起而构成,支持结构化和专门的查询、报告分析和决策制定。数据仓库最根本的特点是物理地存放数据,这些数据并不是最新的、专有的,而是来源于其它数据库的。数据仓库的建立不是要取代数据库,但因为它们面向的应用不同,所以要建立在一个较全面和完善的信息应用的基础之上,才能用于支持高层决策分析,而事务处理数据库在企业的信息环境中承担的则是日常操作性的任务。数据仓库是数据库技术的一种新的应用。到目前为止,数据仓库还是用数据库管理系统来管理其中的数据,数据仓库技术主要从数据库中提取部门所需要的数据,以满足部门级的需要[22]。

2.2 数据仓库技术的优越性

数据仓库技术较之传统计的数据库技术有着明显的优越性,具体表现在以下几个方面。

首先,数据仓库是一种有效的管理技术,将分布在网络中不同站点的商业数据集成到一起,为决策者提供各种类型的、有效的数据分析,起到决策支持作用。它是一个坏境,而不是一件产品,它提供用户用于决策支持的当前和历史数据,这些数据在传统的操作型数据库中很难或不能得到[22]

[23]。

其次,传统的关系型数据库RDB遵循一致的关系型模型,其中的数据(记录)以表格的方式存储,并且能用统一的结构化查询语言(SQL,Structual

Query Language)进行数据查询,因此它的应用常被称为联机交易处理(OLTP),其重点在于完成业务处理,及时给予客户响应。它能够处理大型数据库,但不能将其简单地堆砌就直接作为数据仓库来使用。而数据仓库主要工作的对象为多维数据,因此又称为多维数据库。多维数据库的数据以数组方式存储,既没有统一的规律可循,也没有统一的多维模型可循,它只能按其所属类别进行归类。以应用而言,多维数据库应该具备极强的查询能力,且存储的信息既多又广,但由于其完成的是一种联机事物分析(OLAP),因此并不追求瞬时的响应时间,只是在有限的时间中给予响应即被认可[23]。

然而,尽管数据仓库与传统数据库之间存在着如此大的差异,但设计数据仓库并不是完全另起炉灶,而可利用现有的传统处理数据,从中进行信息的综合,从而构造出满足不同需求的数据仓库。即数据从动态的、目前事件驱动的传统工作数据流向静态的、历史性质的数据仓库。从理论上说,从工作数据中战略性地引入到期的数据可以完成这种转变,但是由于受到实际存储容量和技术的限制,这实际上是不可能的。因此必须从工作数据中分离和筛选数据进入到数据仓库中。鉴于以上各种因素,为保证OLAP的性能,必须将数据仓库和传统工作的数据相分离[22]。

最后,数据仓库技术是把不同来源、格式和特点的数据在逻辑上或物理上有机地集中,从而为企业提供全面的数据共享,是企业商务智能、数据仓库系统的重要组成部分。ETL技术是数据仓库技术的主要解决方案,它能够按照统一的规则集成并提高数据的价值,是负责完成数据从数据源向目标数据仓库转化的过程,是实施数据仓库技术的重要步骤[22]

[23]。

2.3 ETL关键技术研究

数据仓库系统的建立就是要通过数据分析来辅助自己决策,把最原始的数据资源转换为信息、知识[24]。不过由于这些数据的来源、格式不一样,导致了系统实施、数据整合的难度。要解决数据一致性与集成化问题,就需要有一个全面的解决方案来摆脱困境,使其能够从所有传统环境与平台中采集数据,并且该解决方案能够对其进行高效的转换,这个解决方案就是ETL[22]。

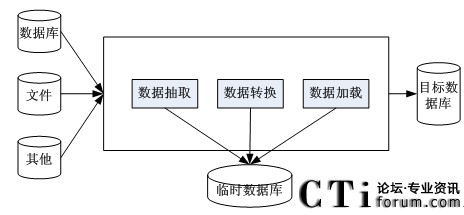

ETL是Extraction, Transformation和Loading的缩写,指数据抽取、转换和清洗、装载的过程。它是实现数据仓库之前的重要步骤,对于仓库中数据质量的保证具有重要意义。它从运作资源中抽取数据并按照一定的要求将数据进行转换和清洗,最后将高质量的数据装载到数据仓库或数据集市中,为更高层次的应用提供决策分析[23]。ETL体系结构如图2.2所示。

图2.2 ETL体系结构图

下面从ETL体系结构出发,由三个方面来详细研究ETL关键技术。

2.3.1 数据抽取

数据抽取是指从数据源中抽取数据仓库系统所需的数据。数据抽取采用统一的接口,可以从数据库中抽取数据,也可以从文件中抽取。对于不同数据平台、源数据形式、性能要求的业务系统,或者不同数据量的源数据,可能采用的接口方式就不同。为了保证抽取效率,减少对生产运营的影响,对于大数据量的抽取,采取“数据分割、缩短抽取周期”的原则,对于直接的数据库抽取,采取协商接口表的方式,保障生产系统数据库的安全。

从数据库中抽取数据一般有全量抽取和增量抽取两种方式[23]。

1.全量抽取

全量抽取类似于数据迁移或数据复制,它将数据源中的表或视图的数据原封不动的从数据库中抽取出来,并转换成自己的ETL工具可以识别的格式。总体来说,全量抽取比较简单。

2.增量抽取

增量抽取只抽取自上次抽取以来数据库中要抽取的表中新增或修改的数据。在ETL使用过程中,增量抽取较全量抽取应用更广。如何捕获变化的数据是增量抽取的关键。捕获变化时,首先要能够将业务系统中的变化数据按一定的频率准确地捕获到;其次不能对业务系统造成太大的压力,影响现有业务。

2.3.2 数据转换和加工

从数据源中抽取的数据不一定完全满足目的数据库的要求,例如数据格式的不一致、数据输入错误、数据不完整等等,因此有必要对抽取出的数据进行数据转换和加工。

数据转换,主要是针对数据仓库建立的模型,实现数据从业务模型到分析模型的转换。数据转换是将源数据变为目标数据的关键环节,它包括数据格式转换、数据类型转换、数据清洗、数据拆分、数据汇总计算、数据拼接等,保证来自不同系统、不同格式的数据和信息模型具有一致性和完整性,并按要求装入数据仓库。

数据的转换和加工可以在ETL引擎中进行,也可以在数据抽取过程中利用关系数据库的特性同时进行[23]。

1.ETL引擎中的数据转换和加工

ETL引擎中一般以组件化的方式实现数据转换。常用的数据转换组件有字段映射、数据过滤、数据清洗、数据替换、数据计算、数据验证、数据加解密、数据合并、数据拆分等。这些组件如同一条流水线上的一道道工序,它们是可插拔的,且可以任意组装,各组件之间通过数据总线共享数据。

2.在数据库中进行数据加工

关系数据库本身已经提供了强大的SQL和函数来支持数据的加工,如在SQL查询语句中添加where条件进行过滤,查询中重命名字段名与目的表进行映射,substr函数,case条件判断等等。

相比之下,直接在SQL语句中进行转换和加工更加简单清晰,性能更高。对于SQL语句无法处理的可以交由ETL引擎处理。

2.3.3 数据装载

数据加载是将转换后的数据加载到数据仓库中,数据的加载可以采用数据加载工具,也可以采用编程进行数据加载。数据加载具有加载周期,数据加载周期要综合考虑经营分析需求和系统加载的代价,对不同业务系统的数据采用不同的加载周期,但必须保持同一时间业务数据的完整性和一致性。

将转换和加工后的数据装载到目的库中通常是ETL过程的最后步骤。装载数据的最佳方法取决于所执行操作的类型以及需要装入的数据量。

2.4 本章小结

本章对可定制报表系统所涉及的数据仓库和ETL关键技术进行了综述性的研究。该部分主要介绍了数据库概念,研究了数据仓库技术较之传统数据库的优越性,数据ETL关键技术以及其各步骤的具体流程,为可定制报表系统的解决方案做了关键性技术前提。

本文未经许可谢绝转载!

呼叫中心中可定制报表系统的设计与实现(二)

呼叫中心中可定制报表系统的设计与实现(三)

呼叫中心中可定制报表系统的设计与实现(四)

作者独家供稿 CTI论坛报道

| 基于VoiceXML可视化IVR系统设计和实现(四) 2010-01-07 |

| 基于VoiceXML技术可视化IVR设计和实现(三) 2009-12-29 |

| 基于VoiceXML技术可视化IVR设计和实现(二) 2009-12-29 |

| 基于VoiceXML的可视化IVR系统设计和实现(一) 2009-09-22 |

| 上海易谷与Genesys达成大中华区长期合作伙伴关系 2009-04-17 |